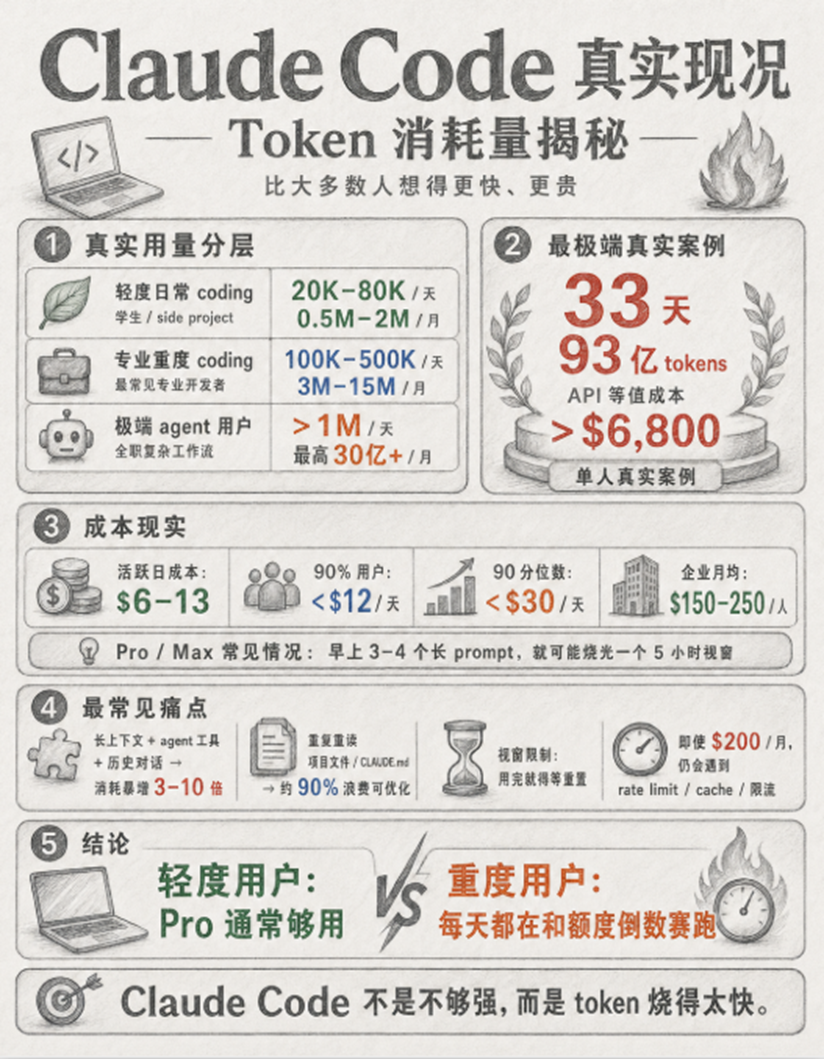

Claude Code 的真实现况:Token 消耗量数据揭秘

根据 2025–2026 年 Reddit、X(Twitter)、企业部署报告与 Anthropic 官方数据,大多数 Claude Code 用户的 token 消耗量远超想象:

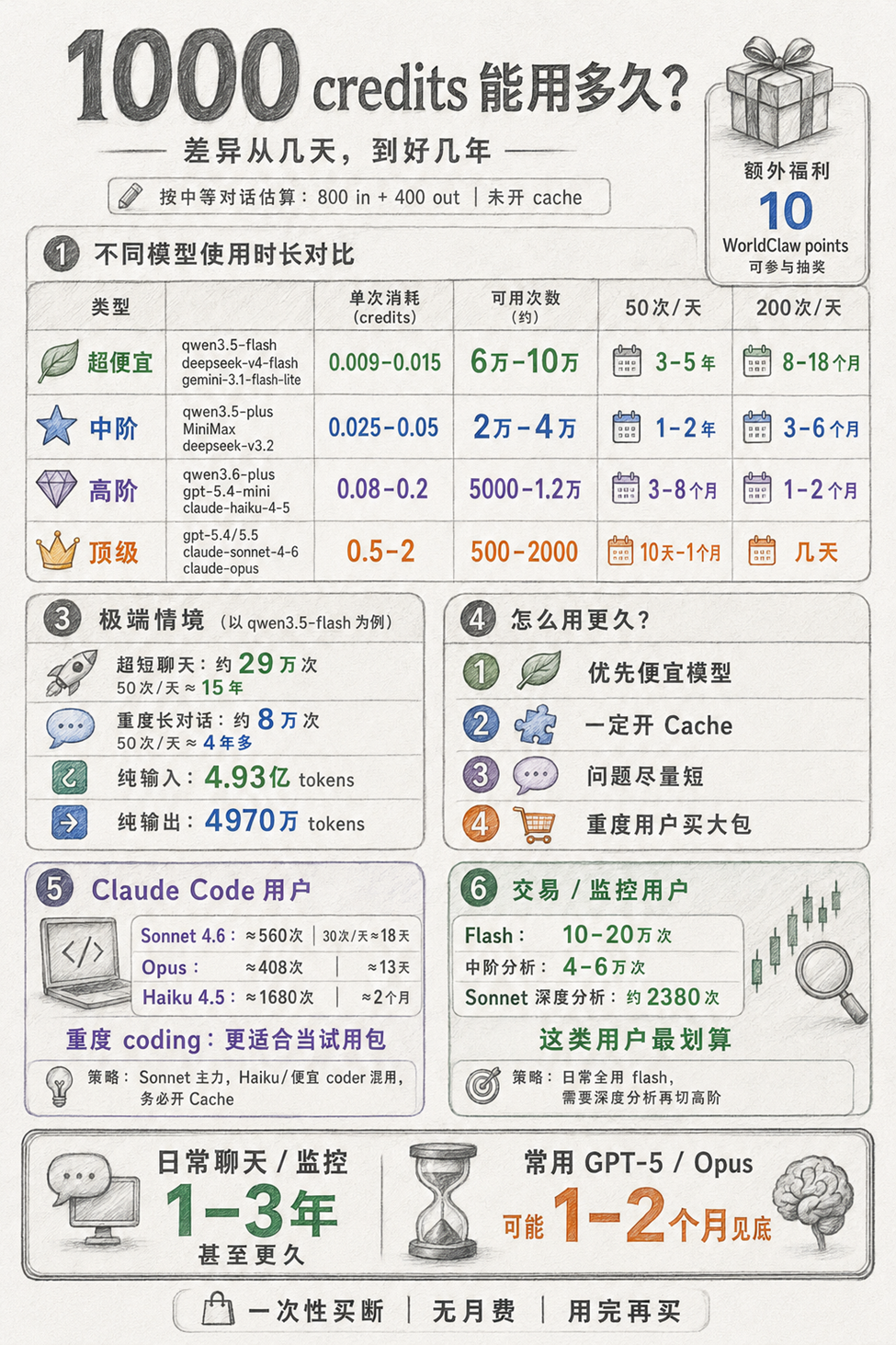

- 轻度日常 coding 用户:每日 20K–80K tokens,每月约5M–2M tokens。

- 专业重度 coding 用户:每日 100K–500K tokens,每月 3M–15M tokens。

- 极端 agentic power user:每日可轻松破 1M tokens,单月最高达 30 亿 tokens 以上(单人 33 天烧掉 93 亿 tokens 的真实案例已出现)。

Anthropic 的 Pro / Max 订阅虽然提供「每 5 小时窗口额度」,但实际使用时经常出现「早上三、四个长 prompt 就烧光一整个窗口」的状况。许多开发者在 X 上抱怨:「付了 $200 月费,却还要盯着 rate limit 倒数。」更棘手的是 prompt caching 效率 与 长上下文历史 问题。每次呼叫工具、读取项目文件、或继续上一个 session,都会重复消耗大量 input tokens。企业级报告显示,90% 的 token 浪费其实来自「可优化但未优化的重复内容」。

这正是 WorldRouter 能发挥巨大优势的地方它不只提供 一次性买断的 AI token credits,还能同时路由多家顶级模型(含超低价 flash 与 coder 系列),并拥有更弹性的 Cache 机制,让同样的 coding 任务消耗的 credits 大幅降低,可以适用于任何的镜像站中转站。

国内用不了大模型的最佳解方

WorldRouter 的最大优势,就是能根据不同使用者的实际需求,透过多模型智能路由 + 弹性 Cache,让 1,000~1,000,000 credits 发挥最大价值。以下针对四种常见使用者类型,提供极为详细的推荐策略。

由于众所周知的网络限制,Claude、GPT-5、Gemini 等多数海外顶级大模型都无法直接稳定访问,即使透过中转也常面临 IP 封锁、API Key 难以注册、充值困难、速度慢、费用高等问题。许多开发者因此被迫使用国产模型,却又牺牲了 Claude Opus / Sonnet 的 coding 实力。

这里先很直观的去进行一个初步使用者教学,再来谈谈他到底有那些方案跟用法

( 以下教学也也适用其他的小型中转站 )

- 1. 注册一个钱包并在里面充值USD1

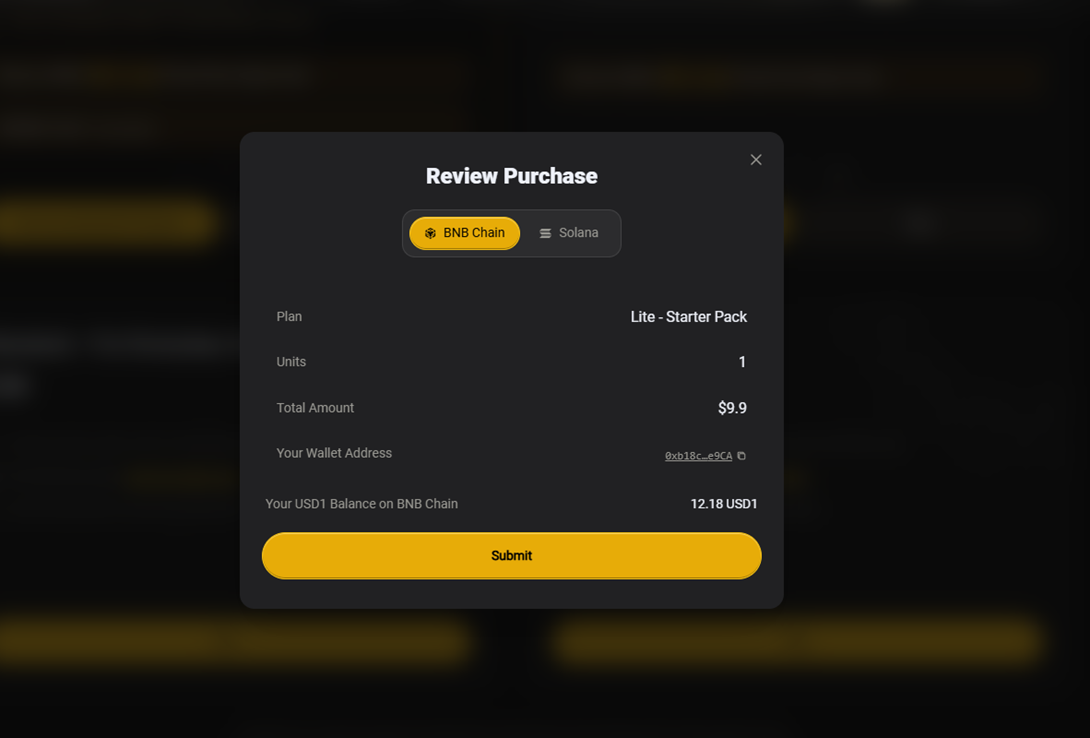

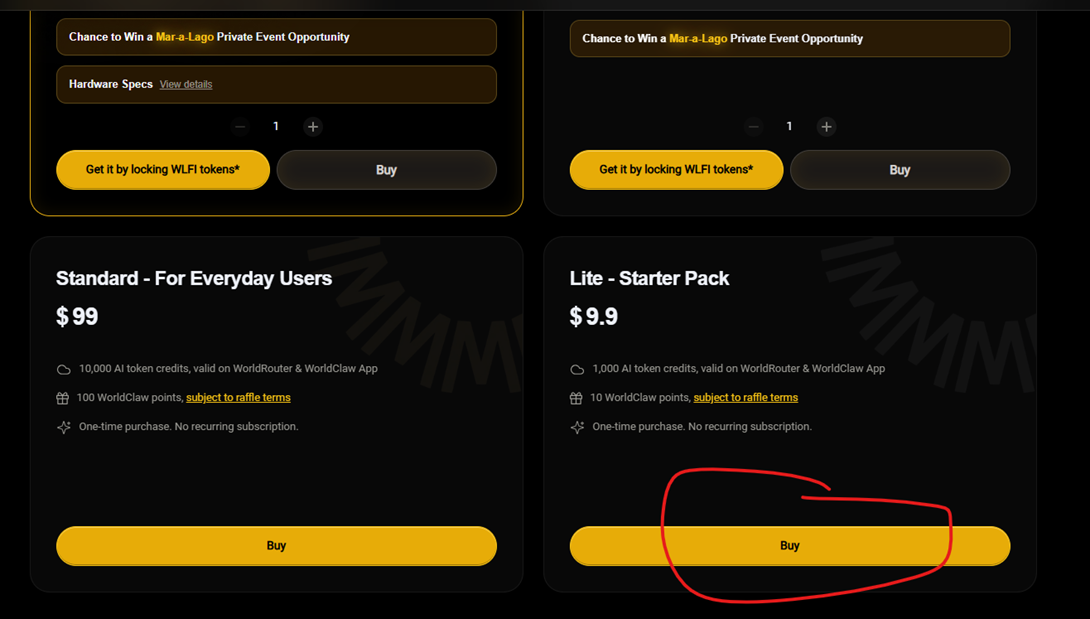

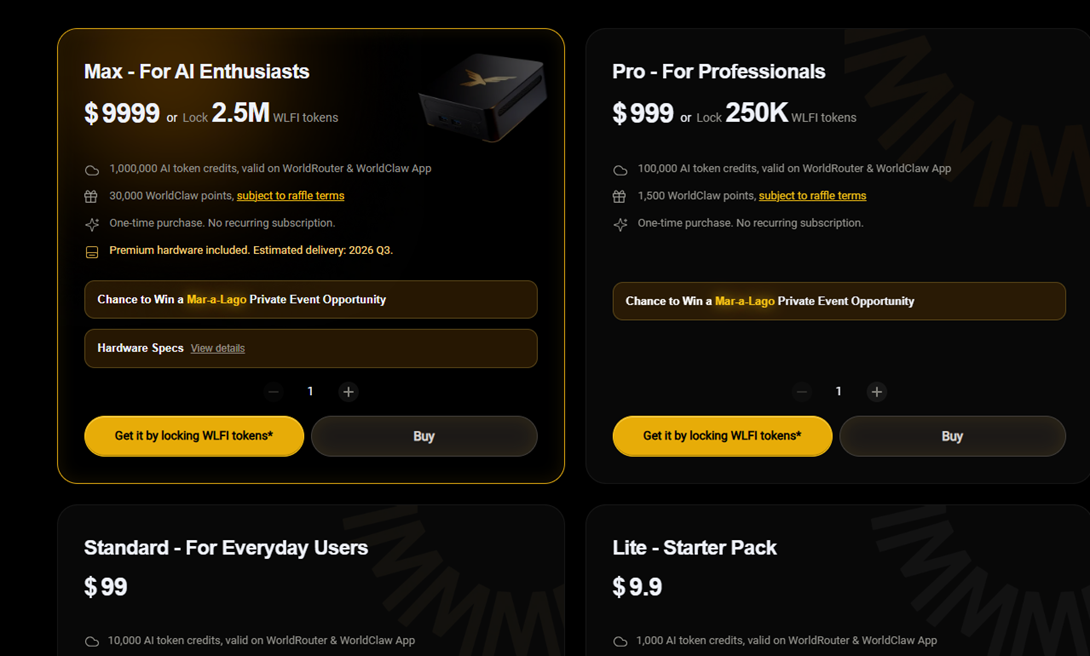

- 2. 进入https://worldclaw.ai/#world-router ,并滑到最底下选择方案购买 (新手一律推荐买最便宜的)

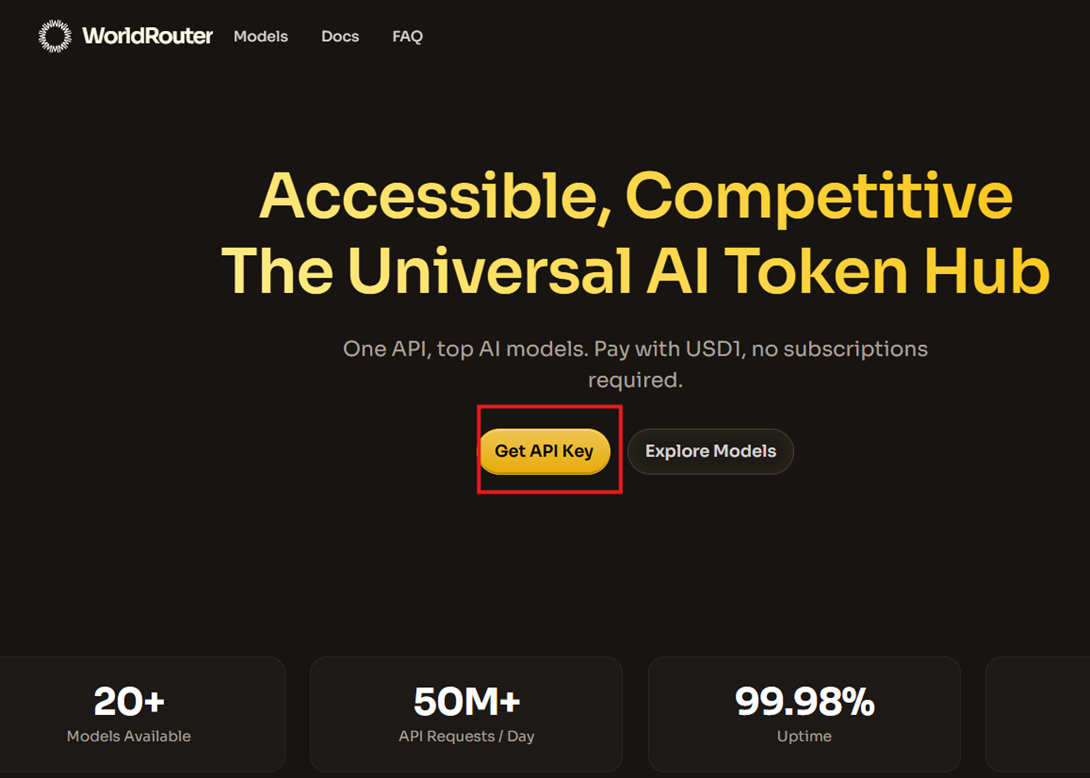

- 3. 设置API KEY,往上滑你会看到这个

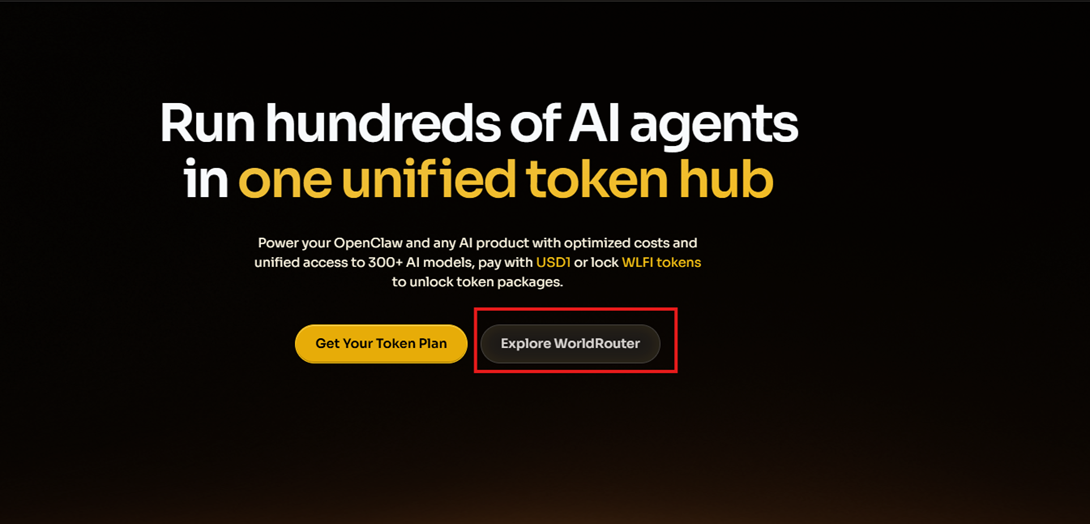

- 点击Explore WorldRouter,这时候你就会进入这个页面

- 点选左边的

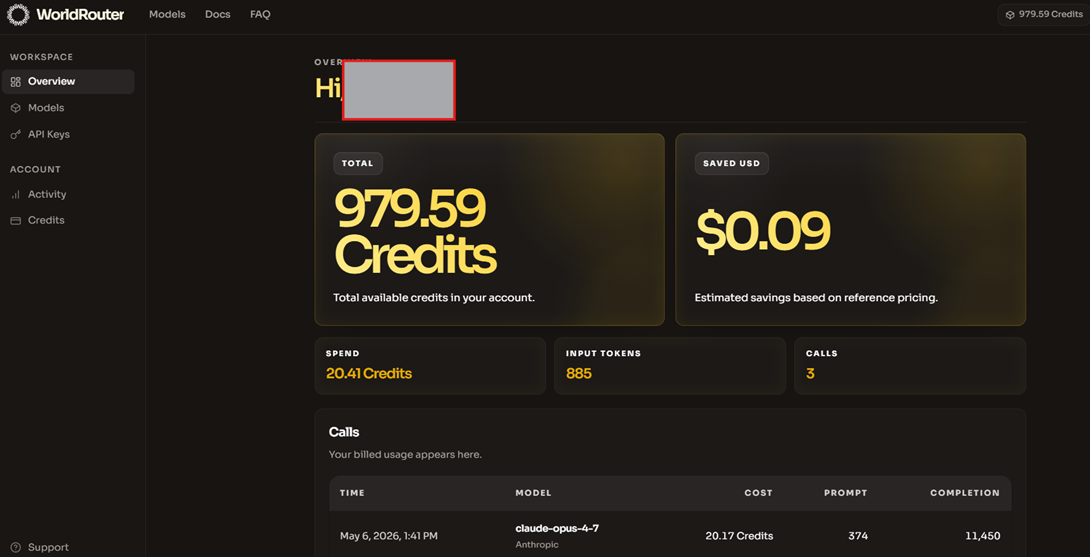

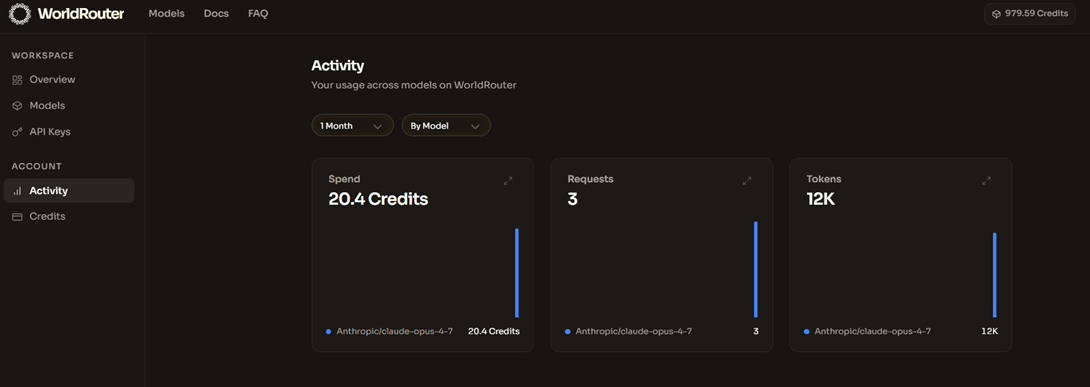

- 接下来你就会跳到主控版,这里会显示你剩下的额度省下的钱,以及调用的模型,当然你现在还没开始用进去应该只会看到 1000 点。

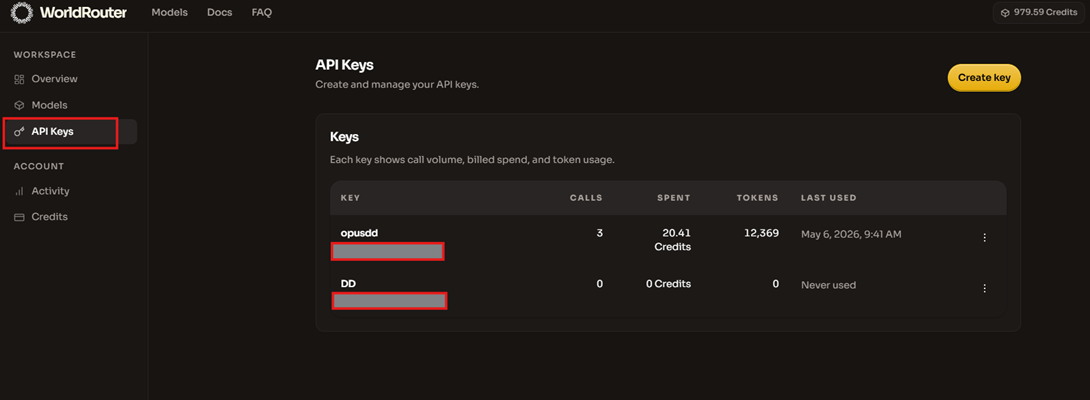

- 接下来我们点到旁边的 api keys这边可以创建api keys。

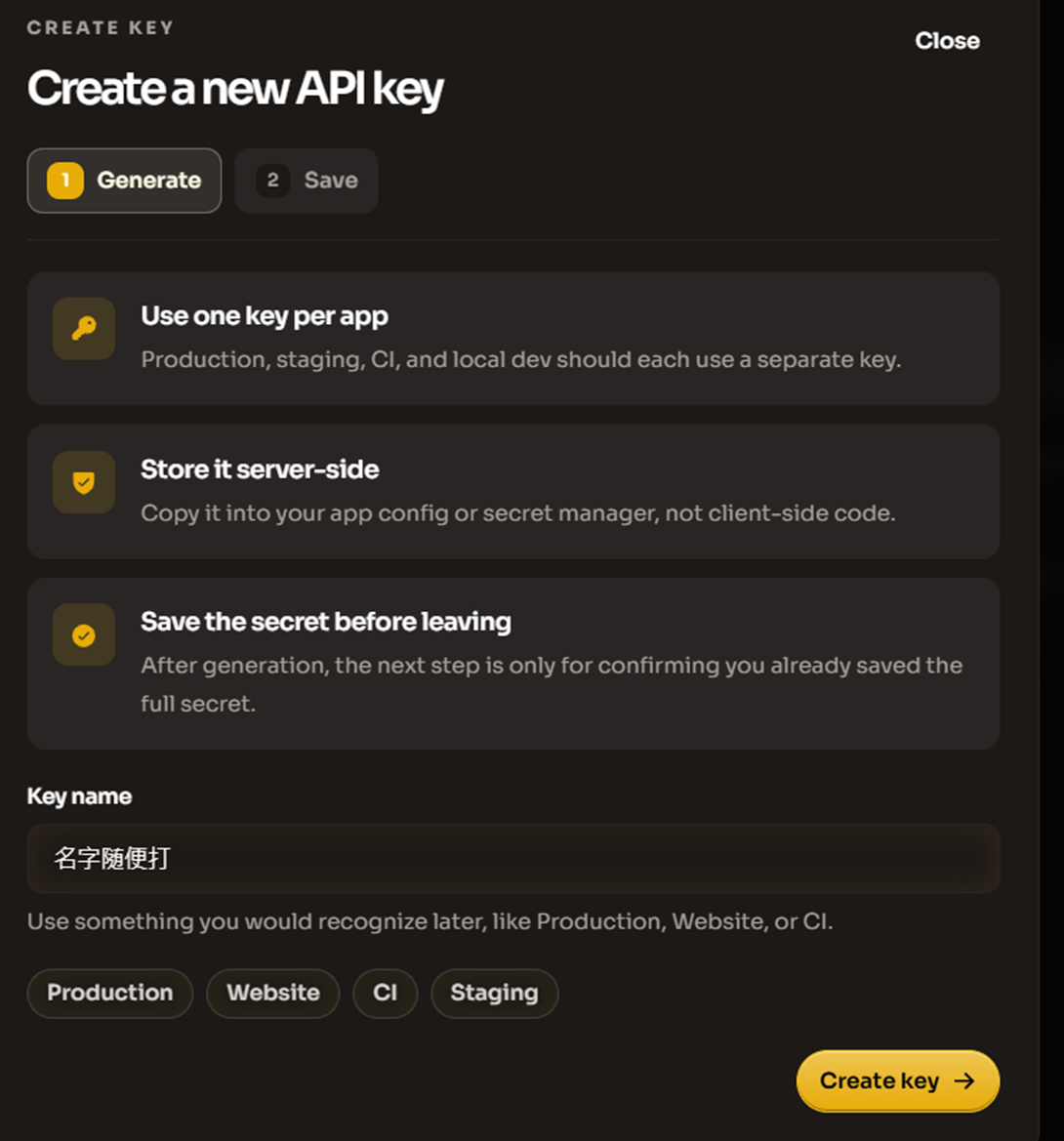

- 然后点右上角黄色按钮可以create keys。

- 这边名字随便打

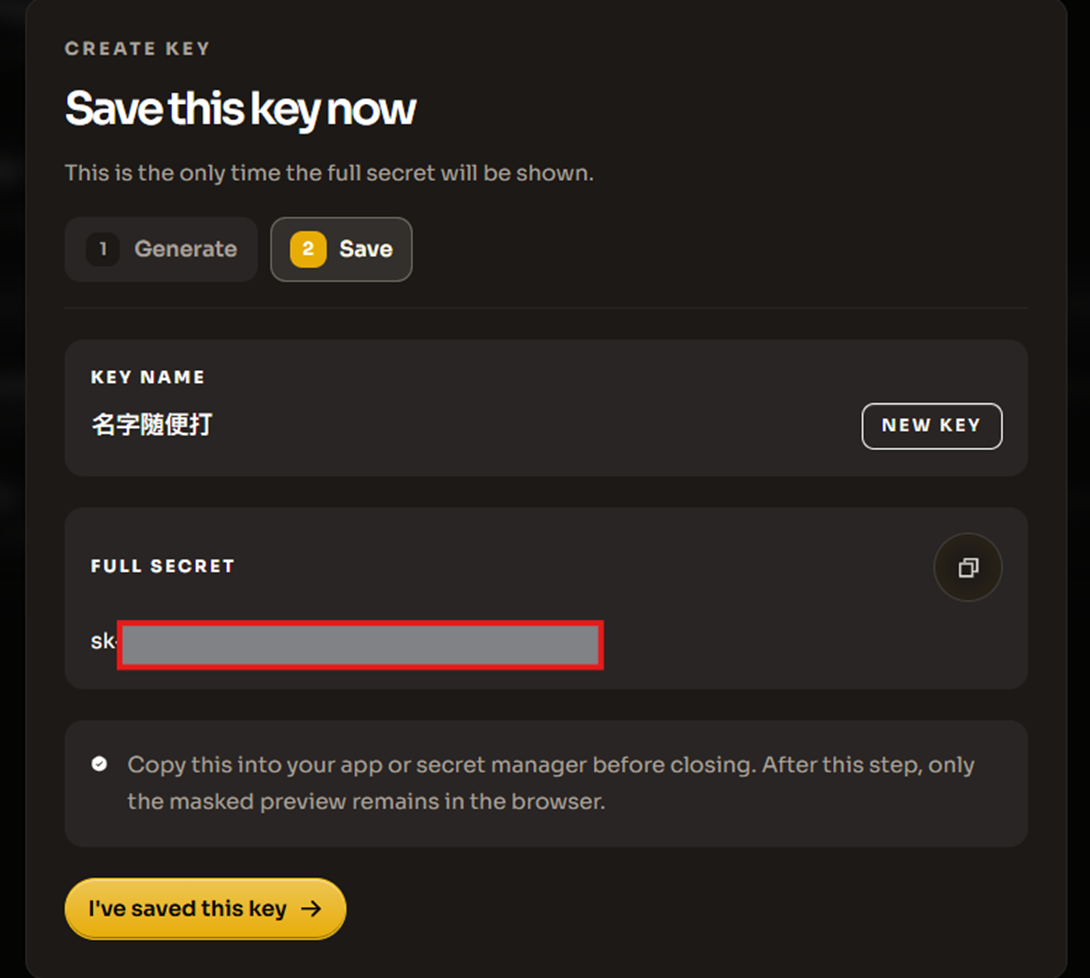

然后你就会拿到一组sk开头的key,接下来就是去使用的时候了。

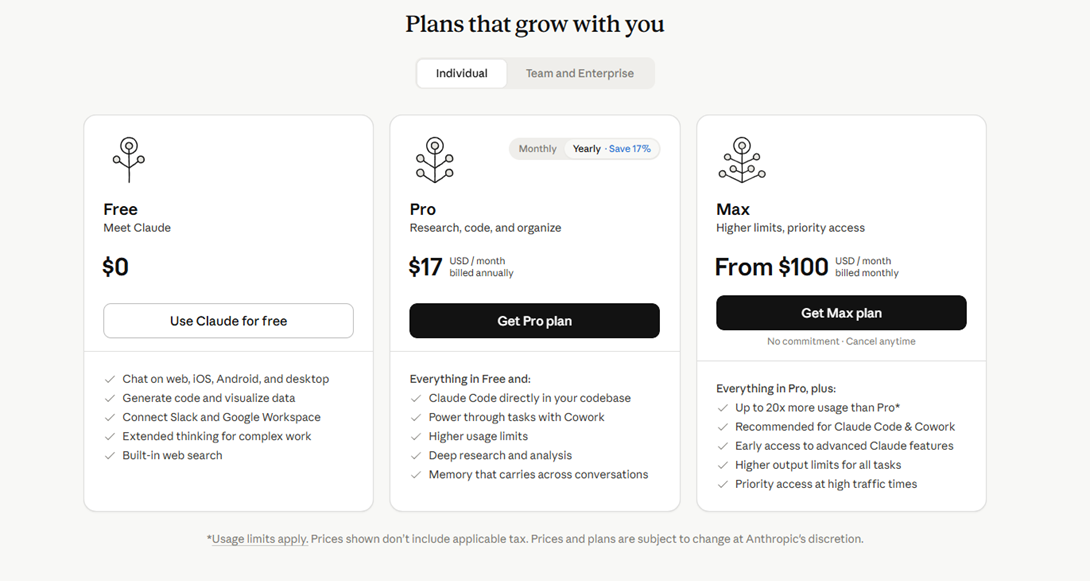

目前最火的大模型叫Claude 最新的模型Opus 4.7 ,但是官网上最新的模型理论上要花17或100美金你才能玩,可是有了openrouter你不用到10美金就能自由去用。

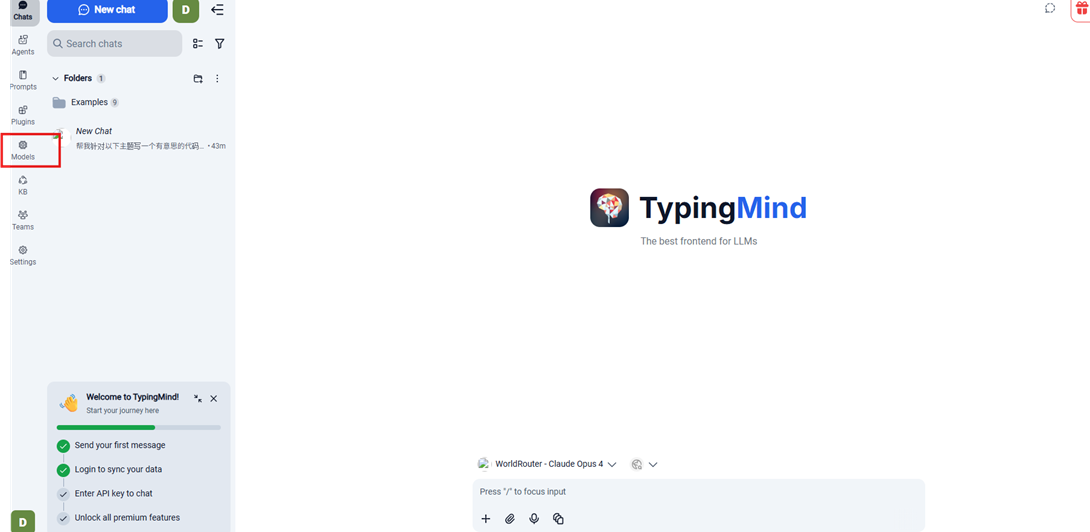

接下来就分享怎么用,首先我们先上最大的镜像站https://www.typingmind.com/。

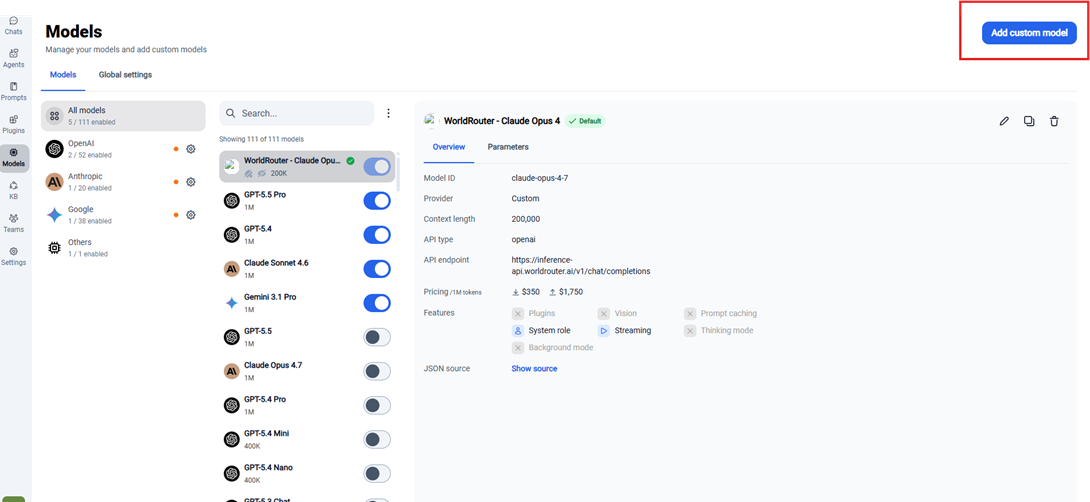

- 点击侧边的models

- 再点击右上角

接下来输入参数

一、Basic Configuration 基本设定

Name:WorldRouter Claude Opus 4

API Type:OpenAI Chat Completions API

Endpoint URL:https://inference-api.worldrouter.ai/v1/chat/completions

如果你使用的平台会自动补上 chat completions,可以改填 -https://inference-api.worldrouter.ai/v1

Model ID:claude-opus-4-7

Context Length:200000

Icon URL:可以留空,也可以填入 -https://upload.wikimedia.org/wikipedia/commons/thumb/8/8a/Anthropic_Logo.svg/512px-Anthropic_Logo.svg.png

Pricing

- Input tokens:350

- Output tokens:1750

这里只是用来估算花费,不影响模型是否能使用。

二、Authentication 验证设定

Authentication Type

API Key via HTTP Header

Header Key

Authorization

Header Value

Bearer sk你的完整 API 密钥

注意 Bearer 后面一定要空一格,后面接你的 sk 开头密钥。

正确格式范例:Bearer sk-proj-xxxxxxxxxxxxxxxxxxxxxxxx

(不要多打其他文字,不要漏掉 Bearer)

三、如果平台是 API Key 字段模式

有些平台不是填 Header Value,而是只给你 API Key 字段。这种情况通常只需要贴纯密钥(sk你的完整 API 密钥),不需要加 Bearer 。

四、测试方式

全部填好后,点右下角 Test。如果出现绿色成功提示,或模型有正常响应,就代表设定成功。成功后点 Add,就可以开始使用。

五、常见错误

- 401 错误:通常是密钥错误,或 Header Value 少了 Bearer,请检查格式是否为 Bearer sk你的完整 API 密钥

- Endpoint 错误:请确认 Endpoint URL 是https://inference-api.worldrouter.ai/v1/chat/completions,如果你的平台会自动补 chat completions,才使用https://inference-api.worldrouter.ai/v1

- Model not found:请确认 Model ID 填的是claude-opus-4-7

接下来就可以正常跑了

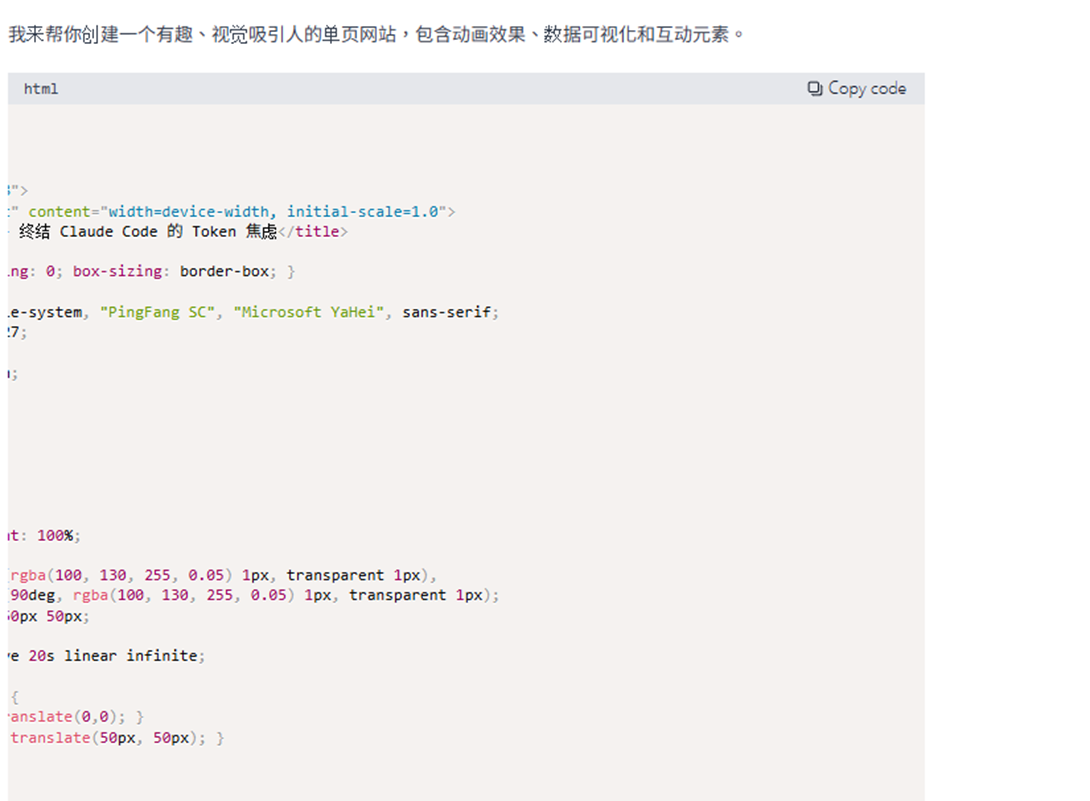

跑完后你就会看到

消耗了多少credits ,由于写网页比较复杂,测试下来大概烧掉20.4 credits ,这就是基础应用。当然有的人不满足于基础,而无论是LiteLLM或其他开源项目 World router都无缝支持。

不过既然是这样的中转我们还是要发挥优势,毕竟world router有的就是这些优势。

成本控管:

高阶模型(如 GPT-5)虽然表现最佳,但价格不菲。对于基础任务(例如摘要、分类),使用较低阶模型(如 GPT-4o mini)甚至本地模型就已足够,能大幅降低支出。

服务可用性:

云端服务不总是稳定。OpenAI 偶尔会遇到 API 限流、服务器异常,甚至因地区或高峰时段导致延迟,这时拥有替代模型就成为保障。

模型多样性需求:

不同模型在不同语言或任务上的表现可能有显著差异。例如,有些模型在中文理解或生成方面经过微调后表现更优;而某些模型在多步逻辑推理任务上则可能具备强项。这种差异性正是应用程序需要具备灵活切换模型能力的原因。

合规与隐私考虑:

部分资料(如财务报告、个资)受限于法规或企业内规,不能传到云端处理,必须依靠本地部署方案确保数据安全。

系统弹性与可测性:

在开发过程中,常常需要比较不同模型的行为差异,或透过 A/B 测试评估结果质量。若能快速替换或混用模型,将大幅提升系统的实验与优化效率。

而Worldrouter 的出现,不仅简化了 LLM 整合的复杂度,也让云端与本地模型能在同一个共存环境中协同运作,是建构多模型 AI 应用时不可或缺的基础工具。接下来,我们将实际操作如何组合式操作。

重度 coding 用户、交易监控用户、一般开发者的策略

1. Claude Code 重度 coding 用户(每日 coding 时间 4 小时以上)

这类用户通常是全职开发者、AI Agent 工程师或团队 Tech Lead,每天会进行大量长上下文 coding、项目重构、工具呼叫、debug 与架构设计。根据全网真实数据,此类用户每日 token 消耗落在 100 K–500 K(极端者可达 1 M+)。

推荐模型路由策略:

主力模型:claude-sonnet-4-6(推理最强,coding 表现最佳);

辅助模型:qwen3-coder-plus(快速 boilerplate、简单 debug)、deepseek-v4-flash(超低价实时测试);

切换规则: 长档分析、复杂架构、agent 工作流 → 固定走 Claude Sonnet 4.6;

快速问答、单档案修改、重复 boilerplate → 自动路由到 qwen3-coder-plus 或 deepseek-v4-flash(可省 80–90% credits);

Cache 设定:务必全程开启,长 coding session 中,CLAUDE.md、项目文件、历史对话的 cache read 可将 input 成本压低至原来的 1/10。

方案推荐与寿命估算(每次 coding 回合平均 2,500 input + 1,200 output tokens):

- Pro(100,000 credits);

- 纯 Claude Sonnet 情境,约可使用 2–4 个月(每日 30–50 次长 coding);

- 混用 flash/coder + 开 cache,可延长至 6–10 个月。

- Max(1,000,000 credits);

- 纯 Claude Sonnet 情境,约可使用 1.5–2.5 年;

- 混用 flash/coder + 开 cache,轻松撑 3–5 年(甚至更久)。

实用操作技巧: 建立专属「CLAUDE.md」并保持精简( 5,000 tokens)。每次 session 结束前用 /cleanup 或手动移除无用历史。设定 WorldRouter 路由偏好:「coding 任务优先 Sonnet,其他任务优先价格最低」。

极端重度用户建议直接锁定 Max 方案,附赠的 Premium 硬件与 Mar-a-Lago 抽奖机会更具长期价值。

2. 交易 & 监控用户(看盘、策略分析、实时数据解读)

这类用户特点是高频但短 prompt:每分钟可能查一次 ticker、指标、风险评估,或跑简单回测;每日查询次数高(50–200 次),但每次对话极短(400 input + 200 output tokens 以下),属于「快问快答」情境。

推荐模型路由策略:

主力模型:deepseek-v4-flash、qwen3.5-flash、gemini-3.1-flash-lite(速度最快、价格最低)

辅助模型:claude-sonnet-4-6(仅用于复杂策略设计、数学模型、风险回测)

切换规则:日常监控、实时数据解读、简单图表分析全走 flash 系列;只有需要深度推理时才短暂切 Claude。

方案推荐与寿命估算(每次对话平均 400 input + 200 output)

- Standard(10,000 credits)

- 纯 flash 情境:约可使用 1.5–3 年(每日 100 次也完全够);

- 偶尔混用 Claude:仍可撑 10–18 个月。

- Pro(100,000 credits):

- 纯 flash 情境:轻松使用 15–30 年(基本上买一次用到退休);

- 混用 Claude 10% 比例:仍可撑 4–8 年。

实用操作技巧: 开启 cache 后,重复查询同一个 ticker 或指标几乎不消耗 credits,把常用指标写成固定 prompt template,让 WorldRouter 自动快取。

设定路由偏好:

- 「速度优先 + 价格最低」,让系统自动选最便宜的 flash 模型。

- 这类用户最划算,Standard 方案就几乎是「买断终身使用」等级。

3. 一般开发者(日常 coding + 学习 + 偶尔项目)

这类用户每天 coding 时间 1–3 小时,包含学习新技术、写 side project、简单 debug 与文件阅读。

token 消耗中等,每日约 20 K–80 K。

推荐模型路由策略:

主力模型:qwen3.5-plus / deepseek-v3.2(性价比最高);

辅助模型:claude-sonnet-4-6(重要架构设计或 review 时使用)、claude-haiku-4-5(超快速小任务);

切换规则:80% 任务走中阶模型,只有关键时刻才切 Claude。

方案推荐与寿命估算(每次对话平均 1,200 input + 600 output)

- Standard(10,000 credits)

- 中阶模型 + 开 cache:约可使用 8–14 个月;

- 偶尔混用 Claude:仍可撑 5–9 个月;

- Pro(100,000 credits)

- 中阶模型 + 开 cache:约可使用 6–10 年;

- 混用 Claude 20% 比例:仍可撑 3–5 年。

实用操作技巧:

- 善用 WorldRouter 的「智能路由」功能,设定「预算优先」模式。

- 定期检查 credits 消耗报告,调整模型使用比例。

- Lite 方案适合先试用 1–2 周,确认习惯后再升级 Standard。

这次介绍就到这边其实无论你是哪一类使用者,WorldRouter 都能透过「模型混用 + Cache」让 credits 寿命大幅延长。

重度 coding 用户适合 Pro/Max,交易监控用户连 Standard 都用不完,一般开发者更是 Standard 就足够长期使用。当然如果你真的需要大量使用或是想见偶像,那MAX也是很棒的选择。

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。